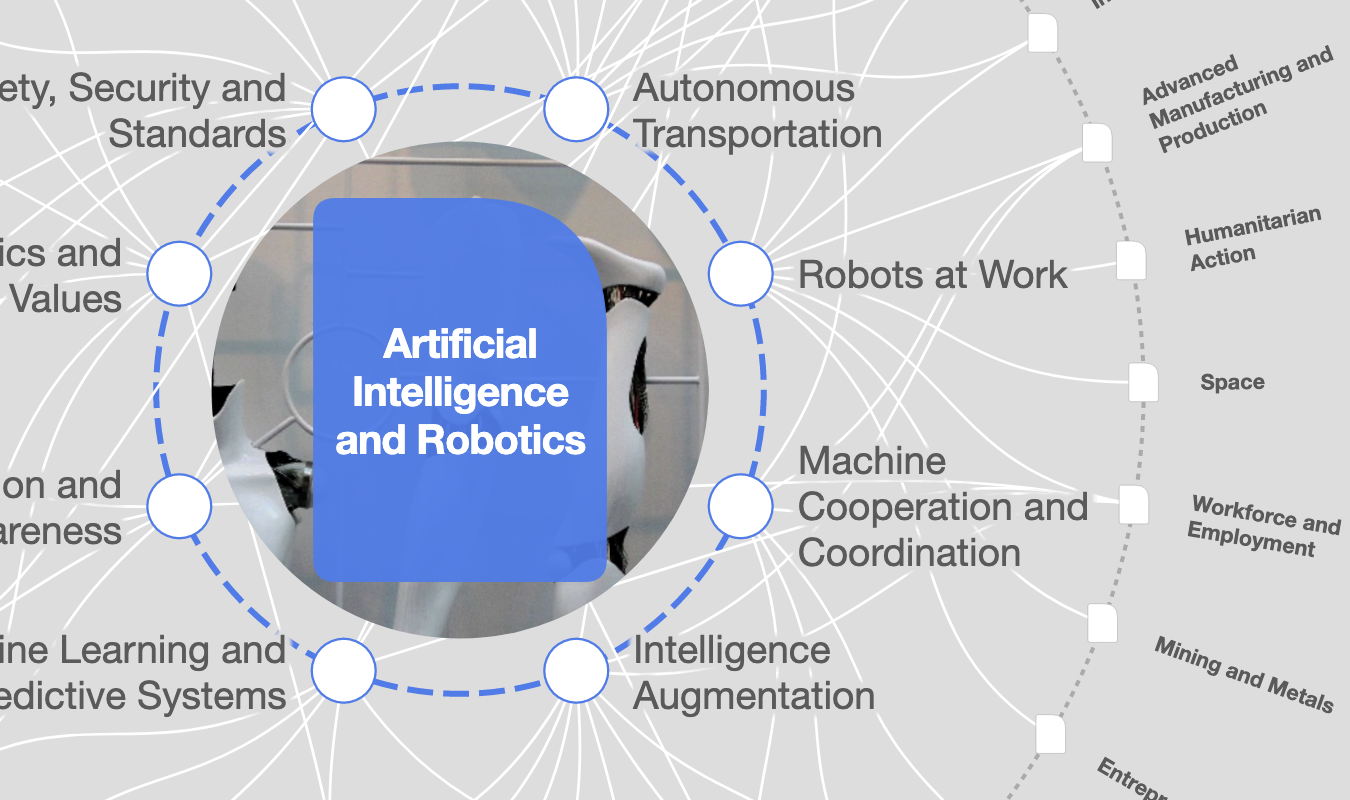

人工智能与现实世界的交互对网络安全意味着什么?

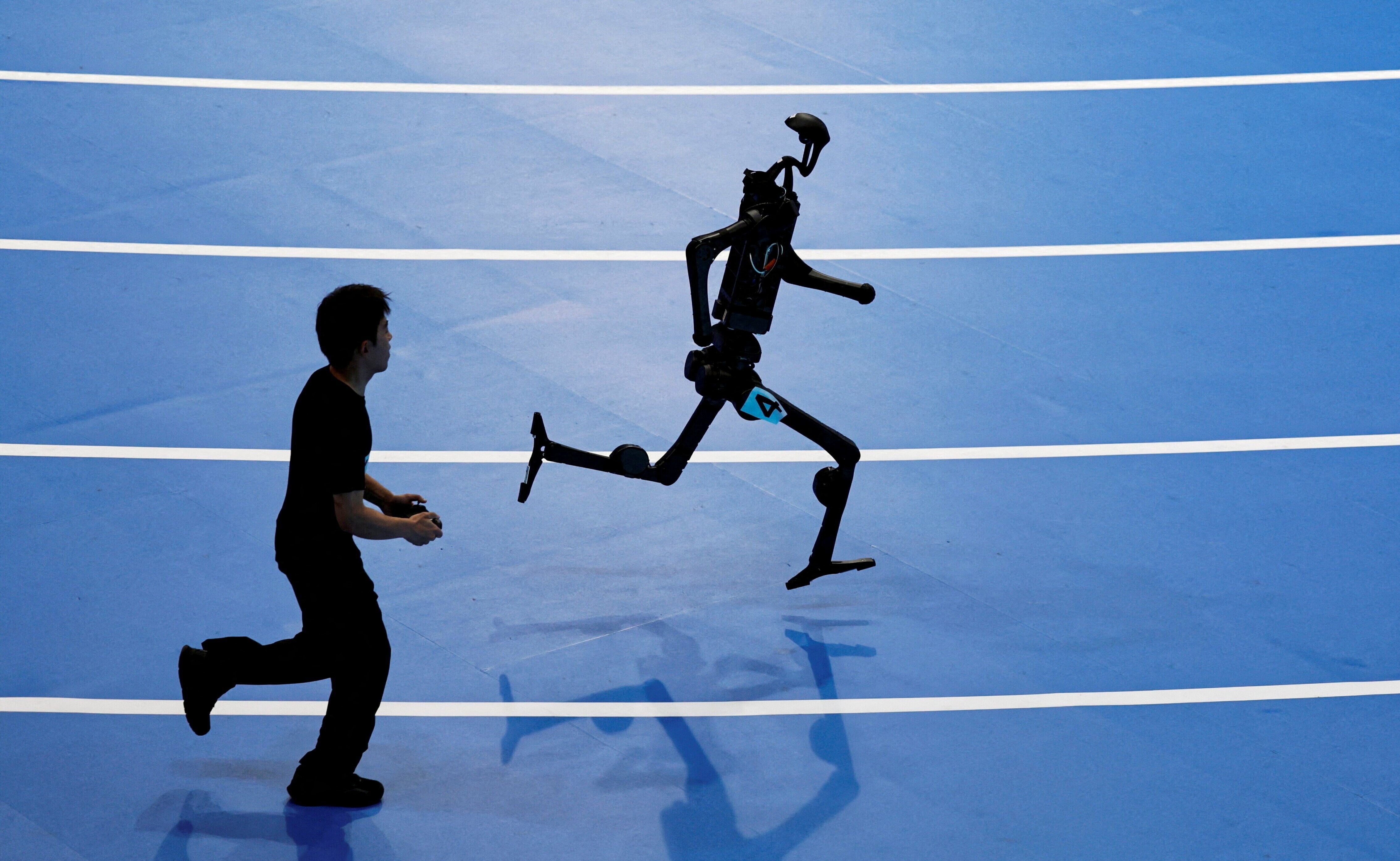

机器人,尤其是那些可能由人工智能驱动的机器人,意味着除了传统网络威胁之外,还可能带来现实世界的实际后果。 Image: Shutterstock

Daniela Rus

Director, Computer Science and Artificial Intelligence Laboratory, Massachusetts Institute of Technology (MIT)- 随着人工智能(AI)系统开始在物理世界中执行操作,网络故障将转化为物理故障,直接危及人身安全、业务运营与社会信任。

- 网络安全的风险随之攀升,然而我们扩展自主性与能力的速度,却远超其赖以立足的安全基础建设步伐。

- 物理AI的采用,将有赖于“安全设计”系统、统一协调的标准,以及对安全与韧性领域的更大投入。

物理AI让自主系统(例如机器人和自动驾驶汽车)得以在现实世界中感知并采取行动。与具身AI不同,后者仅聚焦于硬件“躯体”与环境交互时所采集的智能信息;而物理AI则属于一个更为宏观的整体框架,使软件“大脑”能够更智能地控制各类物理躯体,包括机器人、机械臂、无人机及自动驾驶车辆等。这一领域尚属新兴,既缺乏统一的标准命名,也远未形成成熟的技术体系,然而许多人深信,它代表着AI发展的下一个阶段。

研究人员相信,通用型物理AI系统走出高度结构化的工业场景、在多个领域实现商业化的那一天,正在迅速逼近。摩根士丹利的分析师则指出,到2050年,人形机器人市场规模将增至5万亿美元。然而,随着这一融合趋势日趋成熟,它在传统网络威胁之外,也催生了一类全新的现实世界后果。倘若从一开始未能将信任、安全与保障根植于设计之中,那么驱动这一增长潜力的自主性本身,就将反过来成为其最大的软肋。

物理AI为何能颠覆游戏规则?

网络安全历来聚焦于保护数字资产,其边界清晰且范围有限。然而,随着数字攻击开始对关键基础设施和医疗系统造成现实世界的实际损害,这一范式正在发生根本性转变。尽管网络安全领域的投入已十分庞大,网络攻击的发生频率与复杂程度仍在持续攀升。

随着AI日益嵌入各类物理系统——从自动驾驶汽车、机器人物流平台,到手术器械乃至关键基础设施——网络安全界长期致力化解的种种脆弱性,如今正被赋予实实在在的物质维度,直接关乎人身安全。物理AI弥合了代码与实体行动之间的鸿沟,也正因此,它将传统网络攻击转化成了直接危及生命安全的风险。

案例一:针对自动驾驶汽车控制器逻辑的攻击

自动驾驶汽车提供了一个极具启发性的案例。现代汽车早已依赖数十个电子控制单元通过内部网络相互通信,而研究人员已多次证实,远程访问并操控其制动、转向及加速子系统的确可行。

物理AI极大地延伸了这一脆弱性的边界。在全自动驾驶或半自动驾驶车辆中,整个运行回路(感知、规划与执行)均由软件协调。该链条上的任何一点遭受攻击,都可能使一台重达数吨的机器以高速公路上的速度失控。可以设想这样一种攻击:它悄然逆转了控制器的逻辑:车辆本应加速,结果却是减速。低速时,这种错乱令人困惑;而在高速行驶、车流密集的情况下,则可能酿成灾难性的伤害。

案例二:供应链中断

其对供应链完整性的影响则有所不同。物理AI系统正越来越多地部署于分拣、包装和配送等环节。一台被攻陷的仓储机器人,可能会贴错货物标签、错误转运货物,甚至在分销链路中混入问题货品。设想一个由AI驱动的药品分拣中心,其标签与拣选系统遭到暗中篡改:在问题被发现之前,大量被错放进正确标签容器里的错误药品,已形成工业化规模。由此引发的下游后果——包括患者出现不良治疗反应乃至公共卫生紧急事件——在性质上与传统的涉及数据泄露的安全事件截然不同,且严重性要深远得多。

案例三:针对感知系统的攻击

另一类风险涉及对感知系统的完整性攻击。物理AI依赖传感器阵列,如摄像头、激光雷达和毫米波雷达,来解读周围世界。然而,对抗性篡改(例如在交通标志上施加视觉“扰动”)可诱使这些系统将停止标志误判为限速标志。这一脆弱性并不局限于道路场景,同样延伸至机场安检、农业和工业检测等领域。在这些场景中,被操纵的传感器数据会扭曲现实,而AI正是基于这种扭曲的现实来执行操作。

物理AI的治理缺口

创新的脚步已经超过了全球标准与治理的速度,造成了数字安全与物理安全标准各自为政、碎片化的局面。

目前,物理AI系统所遵循的监管体系,是由30多项安全与网络安全标准拼凑而成的。这些标准横跨汽车、工业控制、医疗器械以及跨领域AI治理框架,大多为可预测的传统系统而设计,难以应对新技术内在的“黑箱”特性。制造商还面临多重合规的困境——它们不得不在《欧盟人工智能法案》与《欧盟机械法规》等相互重叠的监管要求之间周旋,而这些法规之间往往缺乏一套共通的技术对照基准。

要弥合这一治理缺口,物理AI亟需从静态、被动的治理模式,转向更具协调性的“运行时”治理模式。安全必须从芯片到软件、贯穿整个架构层级加以内嵌,利用独立于AI决策之外的硬件强制限制与机械越控机制来筑牢底线。监管机构须协调统一各项标准,将对抗性韧性确立为一项底线要求。各类组织则须纳入持续监控与压力测试机制,且这些机制必须将真实世界中的物理后果纳入考量。

物理AI承载着巨大的福祉承诺:更安全的道路、更高效的工厂、更优质的服务。然而,这一切皆基于一个根本前提:系统能始终如一地按预期运行。一旦网络攻击者击穿这道防线,所有愿景都将随之崩塌。

当下的资金配置格局,并未如实反映风险的真实量级。大量资金涌入智能系统的开发与建设,但在确保这些系统安全、韧性与可靠方面,投入却远未匹配其应有的比重。

留给我们的窗口期有限。在物理AI大规模部署之前,我们必须构筑起足以保障其可信赖性的安全根基,并建立起能够释放市场预期增长潜力的信任架构。守护人类安全,绝非事后补救之举。它是一项先决条件,更是网络安全与安全领域作为一项共同福祉所共担的责任。

本文作者:

Daniela Rus,麻省理工学院(MIT)计算机科学与人工智能实验室主任

Anna Maria Collard,KnowBe4内容战略高级副总裁兼非洲区首席信息安全官顾问

本文原载于世界经济论坛Agenda博客,转载请注明来源并附上本文链接。

不要错过关于此主题的更新

创建一个免费账户,在您的个性化内容合集中查看我们的最新出版物和分析。

许可和重新发布

世界经济论坛的文章可依照知识共享 署名-非商业性-非衍生品 4.0 国际公共许可协议 , 并根据我们的使用条款重新发布。

世界经济论坛是一个独立且中立的平台,以上内容仅代表作者个人观点。

实时追踪:

人工智能与机器人

分享:

每周 议程

每周为您呈现推动全球议程的紧要问题(英文)