自动化比人们想象的更复杂,原因是这样

对于自动化,每个人都会有自己的见解。人们在这个领域所掌握的知识程度参差不齐,就像人们对于技术革新有着不同程度的恐慌一样。在我的印象中,即使是在这个领域见多识广的作者(包括我自己),由于种种原因也会对自动化避而不谈。

因此,对于正在影响人类如何推进自动化并且未来会一直有所影响的究竟是什么,现在正是提出这诸多因素的时候。这些因素形成了错综复杂的网络,并且需要考虑到诸多的后果。本文将对其中一些因素进行解读。

自动化并不仅仅是劳动力的自动化

因为我们需要依靠工作薪酬生活,忧虑于自动化带来的失业、机器人定律的约束和全民基本收入,所以我们更趋向于关注劳动力范畴内的自动化。虽然劳动力极其重要,但是人们对于自动化的了解也应该更广泛一些,因为自动化会渗透进我们的个人生活,影响我们如何交流、我们在哪里吃饭、购买哪些产品、与谁进行约会、在选举时选择哪个政党等等,所以应该以更全面的角度,从经济、环境、政治、伦理、文化、法律以及社会等方面对于自动化进行讨论。目前,这种讨论还处于边缘状态。

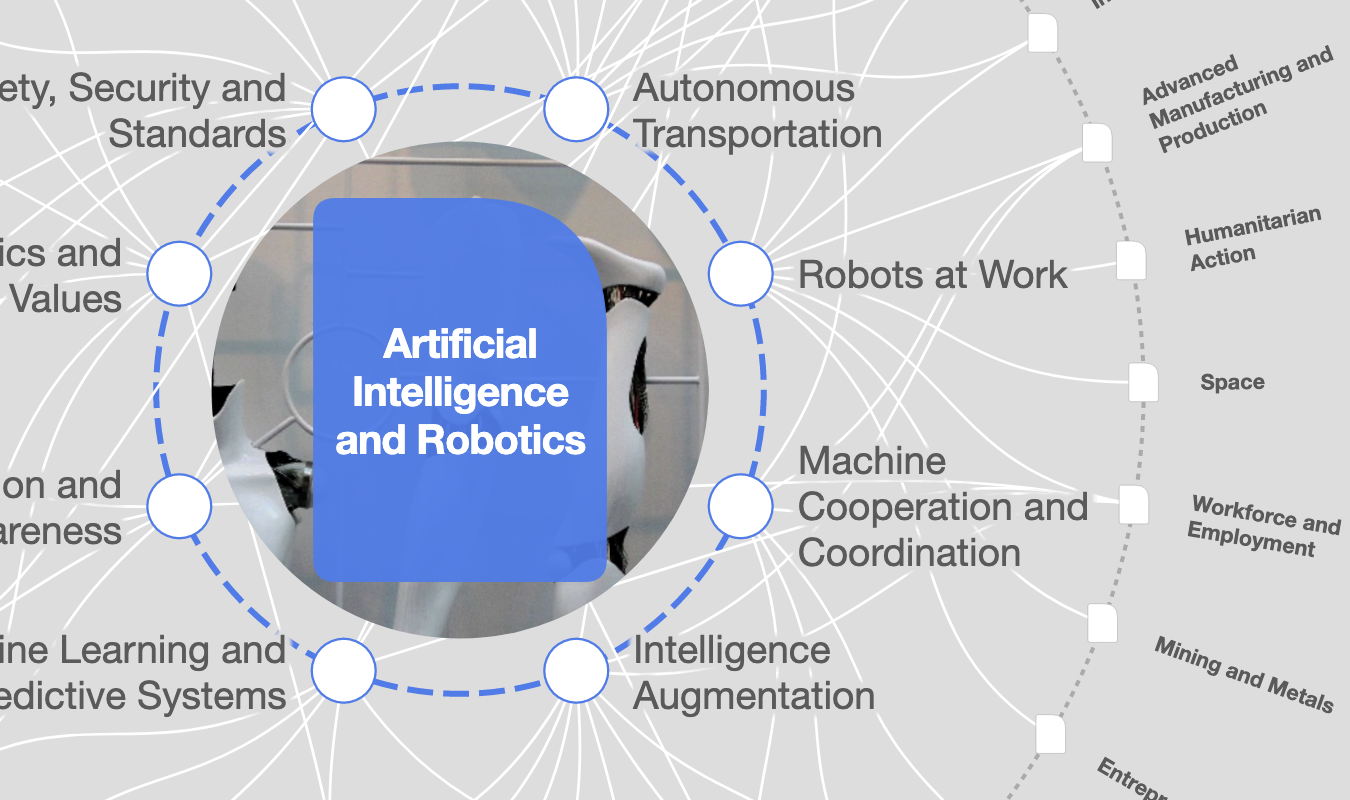

人工智能与自动化的关系

当前人工智能(即机器人所具有的智能)的作用极为有限,这也是为什么自动化非常微妙并且专注于特定的领域。但是,人工智能未来会有更多通用的性能,并将其转化为多领域的机器人劳动力以及具备类似人类推理能力的软件解决方案。在传感器技术、超级计算、神经科学、3D打印和石墨烯等新材料应用这些研究领域的进展会加速这种发展。

自动化的目标是什么?

目标是使一系列不同的任务自动化,在理论上这将会为我们带来益处。现在,人们的着眼点在于使大量复杂而单调重复的任务自动化完成。但是,如果人工智能能够进行支持,任务的范围将能扩大。技术上的可行性和法律的界限是切实的限制因素。

一个公司的出发点在于不断拓展、提高利润,减少人工产生的错误并且减少监管。而人类的出发点则在于避开费力的任务(如在波动的股市中制定交易策略),优化决策过程(如收获粮食的最佳时间),或者使责任由外部承包(如自动驾驶)。

为什么自动化比大多数人想的更复杂

不只是技术上的可行性会对自动化产生影响,在这之外还有一长串相关的变量,如需要考虑到的成本和监管问题。

·自动化的成本:

只要计算化劳动力的边际成本高于人力的成本,使用自动化就是不划算的。在异质的、非重复性的劳动力密集工作中这种情况常常出现。但是,我们需要注意的是,经过一个又一个开发周期,计算化劳动力的性能会得到提升,价格会更加公道。

·工资弹性:自动化也许会使那些期望薪酬低于现有水平的工人数量出现超额供给。为了使人力比起计算化劳动力更具有竞争力,可以解除最低工资的限制。因此,面对计算化劳动力较高的先期投资,雇主在决策时可能会更趋向于价格低廉的人力。

·复杂性:对于需要跨领域知识的任务,从长远看来自动化很难完成需要创造性和共情作用的工作,因为这两者具有较高的复杂度,并且人们对它们的科学认识还远远不够。

·相似相吸:人类和其他高度发达的生命形式都是社会动物。因此,消费者和企业家在计算机模拟、手工制作、非数字化产品以及服务等方面肯定会产生对抗趋势。

·数据可用性:有监督的机器学习等形式的人工智能依赖于大量细粒度的数据集,可能无法用于特定的领域。在其他情况中,我们有大量的数据特别是非结构化数据,但是这些数据集藏身于异质化的数据竖井中,决策者只是没有看到问题的实质。此外,使用有偏差的训练数据会产生意料之外的输出并带来危险。

·数据安全性:此外,我们所处的社会并不一定能够了解在隐私和信息安全方面数据化意味着什么。但是,人们开始意识到这个问题并且在有些情况下也会选择退出数据化的系统,使数据的可用性受到限制(比如有关健康的数据)。

·政策法规:即使从科技层面看使一些任务自动化完成是可能的,但也许一些法规会遏制这种发展。落后的法律法规、尚待解决的伦理问题和安全性威胁(在对于数字技术的讨论中尤为重要)都构成了一定风险。

·采用速度:在各行业中我们会看到对于技术的接受比率是不一样的,而其原因可以追溯到缺乏认知、知识鸿沟、缺少才能或缺乏远见。近来,在非科技和高科技领域的交集处出现了工程师和人才的缺乏,这将会带来交流问题、错误的期望和匮乏的战略决策。由此,对于技术的采用速度会受到文化开放性和包容度的影响。

·伦理:所有可能会带来失业的决策都会造成巨大的伦理困境。至于解决的方式,至少在我看来可以通过评估在某个业务部门中不使用自动化的结果以及长期看来这对公司就业数量意味着什么。现在避免使用自动化会在未来带来更大规模的失业吗?

·对社会的启示:随着我们每天所做的决定许多工作都会被自动化。从个人角度和宏观角度这都将会改变我们所生活的社会。推荐系统和智能筛选算法也许会放大我们决策的泡沫而使我们与现实分离。

·冲突: 随着许多冲突尚需解决,对于劳动力完全自动化的恐惧会被民粹主义利用。但是,我认为除非人类不再向着更高的人道主义进发,在未来我们所面临的问题中科技只是一小部分。我们应该用它解决气候变化、环境污染以及全球粮食短缺问题。不过,技术会引起反对声音甚至暴力也是一个现实问题。这只会发生在社会、技术和政治多相发展的情况下。如果社会需要一段时间才能适应,就指定一个法律框架并使其适用于技术,这样所谓世界末日便只是一种散布恐慌的设想了。

·政治:尽管政治家往往落后于科技发展趋势,他们还是会对科技的扩散产生影响。但是如今这种影响会以相反的方式产生。社会机器人和细分广告能够影响选举,所以对此我们迫切需要找到解决方案。

·责任:如果计算机决策失误,谁来承担责任呢?用户?选择训练数据的数据科学家?机器学习工程师,提供服务的公司,还是其他什么人?我们必须对此进行明确的规定,否则将会像打开潘多拉的盒子一般带来代价巨大的责任问题。

·保险性:上述的风险也许在未来可以规避,但是我们仍缺少恰当的解决方案,这也许会推迟与自动化有关的决策制定。

除了这些因素外,还有一些变量会对自动化的未来产生影响,如文化、宗教、环境、能源、数据存储等等,其中某些变量来源于特定产业或人口驱动因素,或者是社会、经济、环境的特性。此外,我们不得不承认,自动化以及其他技术的发展都不是确定性的,而是会受到全人类的影响。

一方面,我们需要在新的层面有一场透明的、基于知识的讨论来解决上述的问题。而另一方面,承认并不是所有人都想要参与、能够参与这样建设性的对话也十分重要。尽管事实如此,业界、学术界和政界也应开放地沟通彼此对未来的愿景和对于技术发展的协同行为。这样一来每个人才能为他或她自己决定生活中的自动化程度。

作者:Viktor Weber,未来房地产研究所创始人、董事

本文由世界经济论坛博客原创,转载请注明来源并附上原文链接

翻译:世界经济论坛博客翻译小组·徐嘉莹

责编:刘博睿

以上内容仅代表作者个人观点。世界经济论坛博客是一个独立且中立的平台,旨在集合各方观点讨论全球、区域及行业性重要话题。

不要错过关于此主题的更新

创建一个免费账户,在您的个性化内容合集中查看我们的最新出版物和分析。

许可和重新发布

世界经济论坛的文章可依照知识共享 署名-非商业性-非衍生品 4.0 国际公共许可协议 , 并根据我们的使用条款重新发布。

世界经济论坛是一个独立且中立的平台,以上内容仅代表作者个人观点。

实时追踪:

新兴技术

分享:

每周 议程

每周为您呈现推动全球议程的紧要问题(英文)