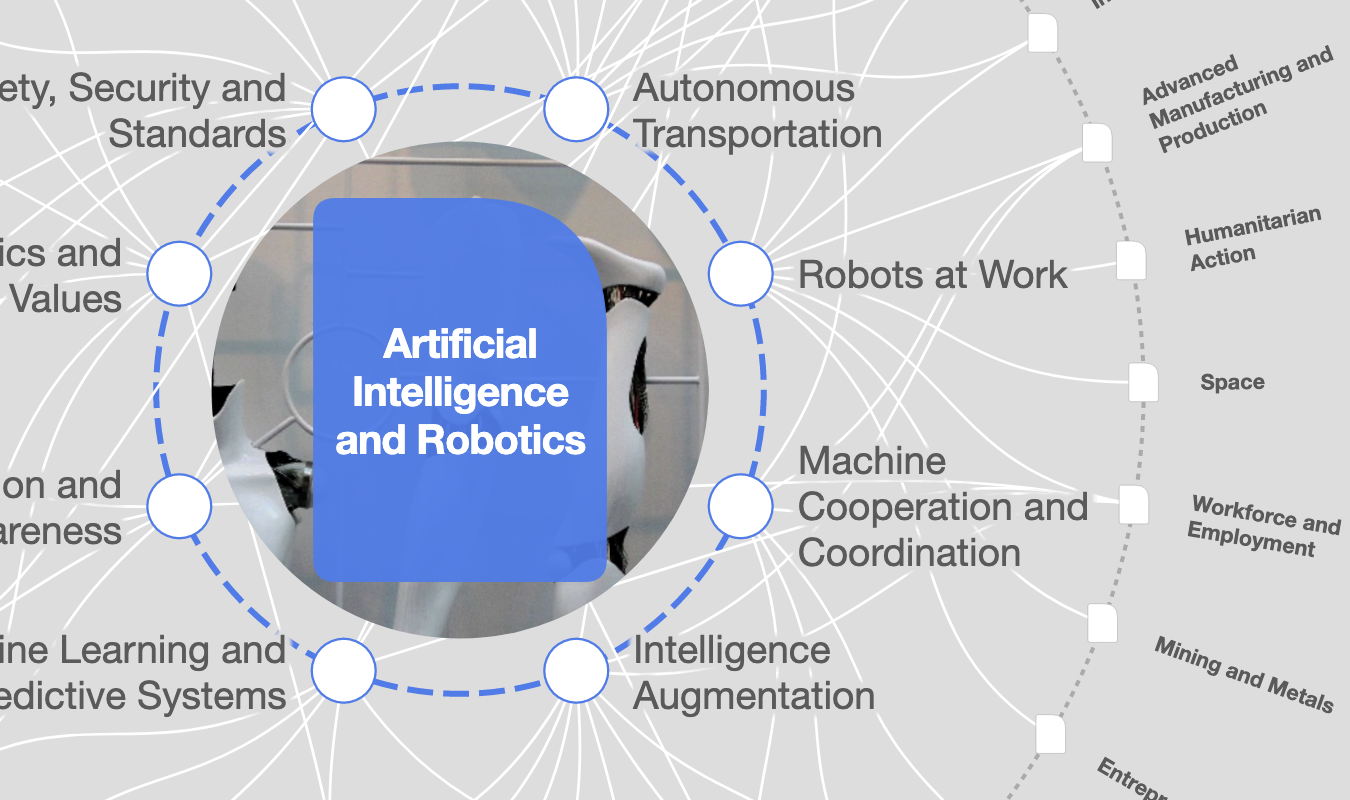

如何应对AI带来的认知操纵与虚假信息?

根据最新发布的《全球风险报告》,错误与虚假信息位列全球最严重的短期风险之一。 Image: Florian Schmetz/Unsplash

- 先进人工智能与合成媒体正在引发一场系统性的全球危机,其风险在于可能破坏现代民主国家的稳定。

- 投机者正利用心理画像和情感触发点来操纵公众认知,加剧社会两极分化。

- 要构建社会层面的抵御能力,需要投资建设健全的验证系统,同时推进积极教育与监管框架。

要解决重大问题并在纷繁复杂的世界中前行,我们首先需要对事实形成清晰、共识的理解。然而今天,社交媒体、在线聊天和人工智能等技术,正让投机者得以用蓄意操纵和混淆视听的叙事来针对特定人群——这些叙事往往旨在激起强烈的情绪反应,如恐惧、焦虑与愤怒。

虚假信息的传播者企图通过认知操纵获取金钱、政治、人身及社会心理层面的利益;他们影响着政府与商业政策的制定,决定着边缘化群体将受到何种对待,甚至左右着人类基本需求能否得到满足。

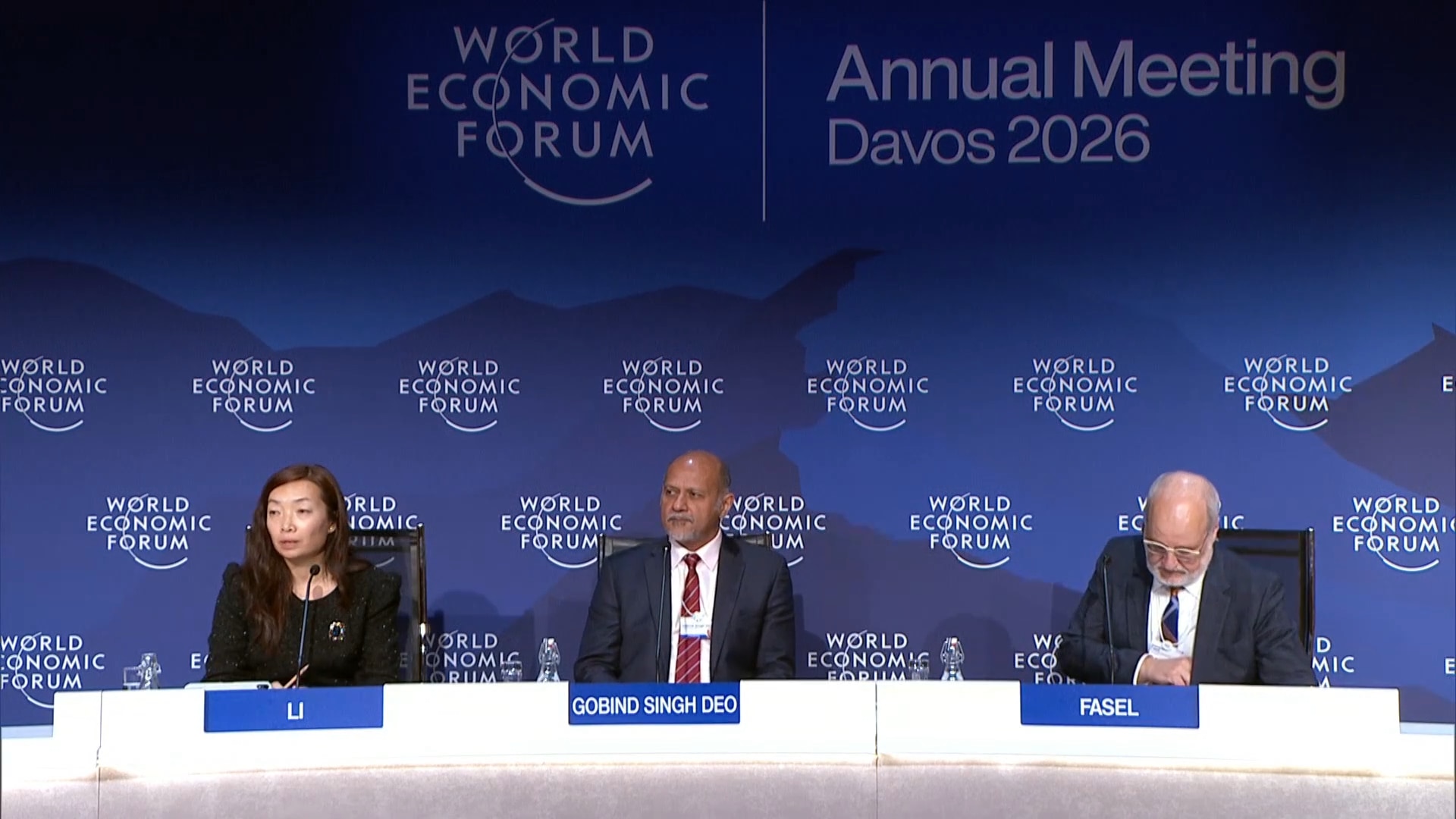

世界经济论坛《2026年全球风险报告》将错误与虚假信息列为短期全球主要风险之一,与地缘经济对抗和社会极化并列。它是少数在两年和十年时间跨度内均持续严峻的风险,更堪称是催化并加剧榜单上所有其他风险的那一个。

从网络风险到系统性危机

到2026年,广泛存在的信息失序已成为一股破坏稳定的系统性力量,可能扰乱民主制度、侵蚀社会凝聚力,并让从经济衰退到气候相关危机等既有问题进一步恶化。

今年正经历一场关键的压力测试。我们面临着挥之不去的经济不确定性、日益激进的极化和帝国主义,以及更精巧的AI叙事。这些动态被AI生成的深度伪造进一步加剧——它们已变得几乎以假乱真,让人们更难分辨真伪,同时也让投机者有了推脱的借口:他们可以假装对此毫不知情。

民主的强弱,取决于随着网络技术普及而崩塌的三大基石能否复兴——验证、深思与问责。如果社会能共同致力于建立对真实的信任(验证),为真诚的好奇、讨论和辩论提供安全空间(深思),并让不法投机者为其造成的伤害承担后果(问责),就能建立起抵御虚假信息的韧性。

信息操纵带来的情绪武器化

一些人工智能系统和投机性势力正主动操纵内容,旨在激发强烈的情绪反应。他们利用行为和心理画像技术,精准定制信息,以迎合或煽动特定群体的某种情绪。结果便是,内容旨在挑起愤怒或恐惧,而非为读者提供信息。

那些易受情绪操纵影响的人群,通过微定向技术可以轻易被识别——这项技术利用用户在线自行报告的数据,揭示其心理特征。一旦识别完成,针对性的信息推送便随之而来,其选择标准在于能否引发情绪共鸣。这些信息之所以容易被分享,是因为它们要么印证了接收者原有的信念,要么煽动了愤怒或不满情绪,要么被认为颇具幽默感。这既加剧了社会两极分化,也让虚假信息得以向更广泛的受众传播。

大型科技媒体平台的激励机制进一步加剧了这些效应——其算法以参与激励(通常为经济上),以及带来自恋式满足的多巴胺快感为奖励,鼓励用户互动。于是,愤怒情绪传播得更快,因为人们在核实事实之前,就会迫不及待地将其分享出去。

2024-2025年选举周期的证据表明,人工智能系统如何在多个国家优化内容,以追求最大的情绪冲击力。同样,2024年的一项研究发现,TikTok上的年轻选民经常接触到误导性的政治内容,包括由AI生成或伪造的政治人物视频。在快速更新的短视频信息流中,这类内容与真实帖子混杂在一起,让用户更难分辨哪些是戏谑调侃,哪些是事实真相。

合成媒体

深度伪造技术在2026年跨过了一个关键的临界点。图像质量大幅提升,早期那些一眼可辨的破绽已不复存在;如今,任何拥有一部智能手机的人都能轻松制作。随着生成式人工智能模型的迅猛发展,信息被滥用的方式也发生了显著演变。

在2024年和2025年的多场选举中,声音克隆与视觉形象深度伪造已成为日益凸显的风险,并成为民主政治中的现实特征。在爱尔兰2025年总统选举中,一则深度伪造视频捏造了最终获胜者退出竞选的消息,甚至包含国家广播机构“证实”该新闻的虚假画面。这段视频在投票日前几天被放出。同样,荷兰也出现了约400张AI生成的合成图像,用于攻击政敌。

关于深度伪造是否比其他传播形式更具操纵性,现有证据似乎不一。然而,越来越多的证据表明,深度伪造确实会对选民眼中被针对的候选人产生负面影响。

2026年,多国选举日程密集,横跨各大洲,某些国家面临不可逆转的民主倒退风险,在此背景下,合成媒体的传播速度与规模构成了叠加风险。事实上,仅仅是知道深度伪造的存在,就足以让我们怀疑自己读到和看到的东西(哪怕是真相)的真实性。

如何抵御虚假信息

纵观历史,虚假信息始终是社会的一部分,未来也或将如影随形。然而,借助当今的技术,其手段之精巧、影响之广泛,被前所未有地放大了。正因如此,我们必须构建抵御的韧性——在保护自身免受其冲击的同时,又不牺牲我们畅所欲言的基本权利。

抵御虚假信息的韧性,源于全社会对验证、深思与问责机制的共同投入。

抵御能力也可源于教育:例如在芬兰,学龄儿童就被教导如何识别并评估是否受到恶意操纵信息的针对。更广泛而言,教育可以帮助人们独立思考六个基本问题:试图与我沟通的人是谁;他们如何、又为何找到了我;与我沟通能给他们带来什么;我能否核实他们信息的准确性;如果我接受这些信息,是否有受伤害的风险;如果我进一步传播这些信息,是否会危及他人?

越来越多的研究正在提供潜在的工具,帮助我们提升识别或标记虚假信息的能力。通过分层检测方法,深度伪造的识别正成为可能。深度伪造往往存在一些不一致之处,即便这些破绽正越来越难以捕捉,如:图像中的噪点模式不匹配或色彩偏移,视频中的唇形同步错误或不自然的眨眼。即便是最新一代的深度伪造,也会留下像素级的痕迹,可供取证工具识别。

追踪传播模式同样大有裨益。恶意的深度伪造内容通常经由机器人或网络水军网络传播。这些账号通过元数据(如创建日期、发帖规律)和行为特征很容易被追踪。此类手段在选举、金融诈骗、冲突及政治报道等场景中尤为有效,因为这种方法比单纯依赖个体用户的识别能力更为有效。

将虚假信息视为治理与风险管理问题而非单纯的内容审核任务,这一点至关重要。《欧盟人工智能法案》通过其风险分级监管要求,体现了这一思路的转变。其中第50条规定,自2026年8月起,人工智能生成的深度伪造内容必须添加标识,合成互动信息必须予以披露,违者将面临高达全球营业额6%的罚款。该法案强调风险分类、文档记录、人工监督及上市后监测,为大规模遏制虚假信息提供了可参照的范本。

2026年的压力测试

虚假信息所带来的认知层面的冲击,将决定未来数年社会演变的走向。正如《2026年全球风险报告》所强调的,虚假信息通过侵蚀信任,放大了从选举到经济危机的每一次冲击,从而加剧了所有重大风险。2026年将考验各机构、社会和平台能否快速适应,以挺过这场虚假信息危机,并坚守住验证、深思以及问责不法投机者的能力。

本文作者:

Sakshee Singh,世界经济论坛战略洞察内容与合作伙伴主管

Alan Jagolinzer,剑桥大学贾奇商学院财务会计学教授

本文原载于世界经济论坛Agenda博客,转载请注明来源并附上本文链接。

不要错过关于此主题的更新

创建一个免费账户,在您的个性化内容合集中查看我们的最新出版物和分析。

许可和重新发布

世界经济论坛的文章可依照知识共享 署名-非商业性-非衍生品 4.0 国际公共许可协议 , 并根据我们的使用条款重新发布。

世界经济论坛是一个独立且中立的平台,以上内容仅代表作者个人观点。

实时追踪:

Disinformation

分享:

每周 议程

每周为您呈现推动全球议程的紧要问题(英文)