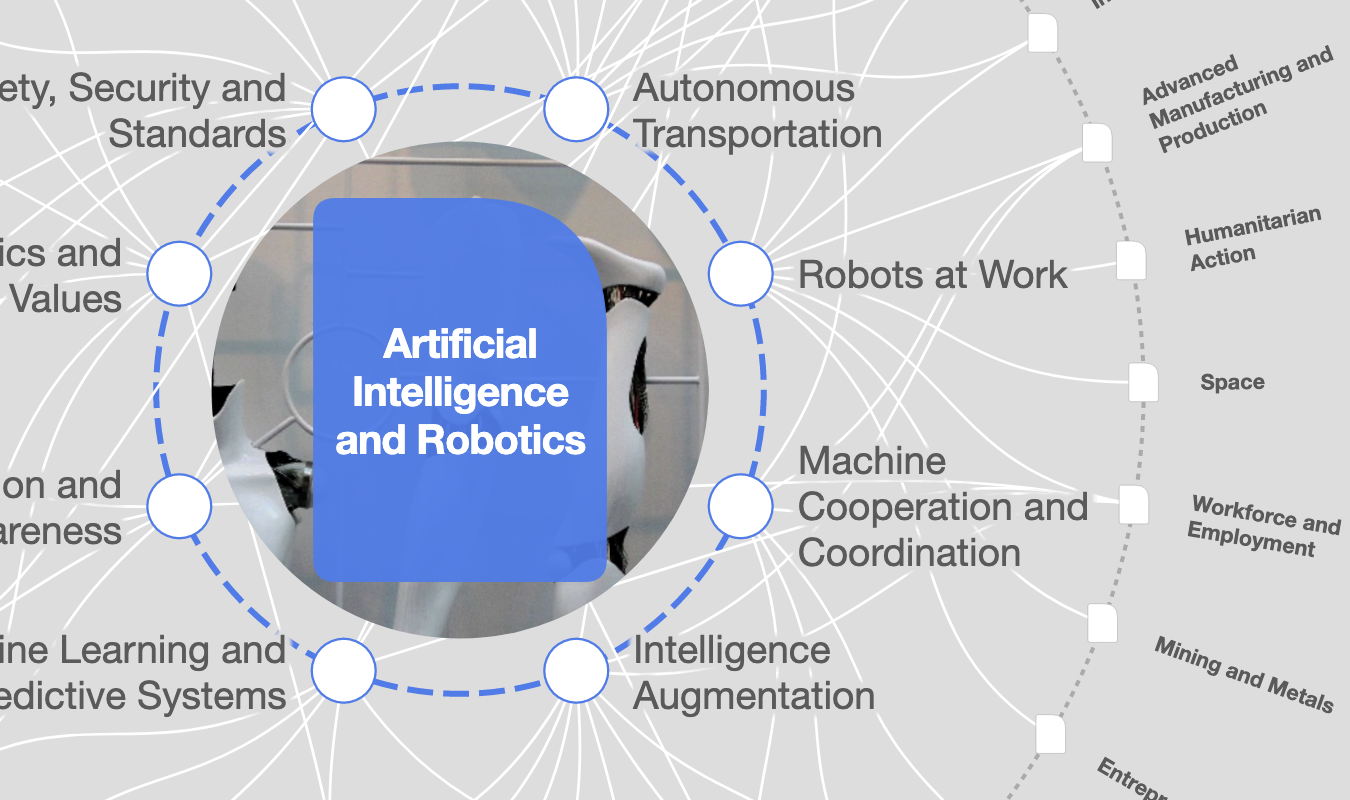

为什么情商是抵御生成式人工智能威胁的最佳防线?

减轻生成式人工智能威胁的第一步是教育。 Image: Unsplash/Thom Holmes

- 情商在识别和管理由人工智能主导的骗局方面至关重要。

- 企业应培训员工识别情绪触发因素,并通过反思减轻生成式人工智能(GenAI)的威胁。

- 鼓励沉着应对而不是冲动反应,有助于防止在决策中滥用AI。

想象一下,您接到孙子打来的求救电话;他描述了一场可怕的车祸,声音充满了恐惧。这就是发生在加拿大里贾纳一名75岁老人Jane身上的事情。

由于情况紧急,她几小时后就赶到银行,为孙子取保释金。后来,她才发现自己是AI生成骗局的受害者。

到2030年,GenAI预计将使全球70%的业务现自动化运营,这令许多领导者既兴奋又着迷。但是,GenAI也有其阴暗面,它的欺骗性也会变成攻击人的武器。

Jane的故事并非个例。情感操控型诈骗也会对企业构成严重威胁,使其面临财务和声誉风险。

最新数据显示,每10位高管中就有1位曾遭遇深度伪造威胁(一种利用真实视频和音频材料训练的AI技术),但仍有25%的领导者不熟悉其风险。

检测AI生成的内容仍是一个难题。要验证数字内容,我们首先还是会寻求技术帮助。虽然许多工具都自诩能够检测AI生成的内容,其准确性却并不稳定。

尤其是随着一些能够绕过检测的工具出现,比如移除图像中的AI水印工具,我们离成功实现AI生成内容的自动标记还很遥远。

尽管一些工具表现出良好的前景,如英特尔的FakeCatcher,但它们尚未实现大规模应用。在各组织努力追赶GenAI发展步伐的同时,人类的怀疑态度仍然是最佳防线。

情商,即识别、理解和管理自己的情绪,是识别AI操控的有利武器。

GenAI带来的三大风险可以通过情商来应对:

- GenAI的超真实输出成为骗子利用如紧迫感或同情心等情绪反应的工具。

- GenAI的道德伦理隐患通常是无意识的,因为员工可能会默认AI的推荐,或陷入自动化偏见,将效率置于道德伦理之上。

- 从工作焦虑到道德冷漠,员工在GenAI带来的情绪压力下可能会做出冲动的决定。

随着GenAI威胁升级,情商变得尤为关键

要管理GenAI威胁的影响,个人必须能够识别涉及到的情绪,反思其影响,并以明智的、有同理心的行动来应对。以下三种方法能够做到这一点。

1. 帮助团队识别情绪被操控的情况

研究表明,人类行为导致了74%的数据泄露,这也不难理解。

GenAI只需分析员工数据或公司特定内容,就能制定个性化的骗局。威胁行为者甚至可以利用个人的数字足迹来创建深度伪造视频。

整个过程只需不到八分钟的时间,成本微乎其微。在此背景下,减轻GenAI威胁的第一步就是教育。

员工需要了解GenAI如何利用情感战胜理性决策。一家网络安全公司的高级经理分享了一段令人大开眼界的经历。

最近,他收到一条WhatsApp消息和一段语音录音,诈骗者冒充其首席执行官,讨论一项紧急商业交易的细节。

最初,来自上级领导的情绪压力引起了反应。然而,骗子对标准化的组织沟通方式的熟悉程度暴露了破绽:不应通过非正式沟通渠道传递敏感数据或进行后续联系。

2. 让反思成为团队的默认模式

个人还应考虑他们在情绪驱使下采取的行动会可能会导致的意外后果。反思可以帮助我们意识到情绪会如何无意识地影响我们的行为。

最近一起缺乏道德监督的案例来自一家德国杂志,其未经一级方程式赛车传奇人物迈克尔·舒马赫(Michael Schumacher)的同意,发表了一篇由AI生成的采访。采访内容包括一些虚假引述,涉及舒马赫自2013年以来的健康状况和家庭生活。

受能够发表“独家新闻”的兴奋驱使,记者没有考虑到该新闻对舒马赫及其家人情感上的影响,最终杂志社遭受了巨大的声誉损失。

工作中的批判性反思可以鼓励我们考虑不同的视角和影响我们选择的因素。领导者可以引入小组反思练习来促进这一点。

一个很好的例子是“旁观者”(fly on the wall)技术:一名团队成员展示GenAI的输出结果,然后静静地观察其他人讨论其伦理考虑因素和偏见。

最后,分享从讨论中获得的启示。经过反思,熟悉的情况可能会呈现出新的含义,揭示潜在的假设,并警告对AI产生依赖性的风险。

3. 将快速反应转化为深思熟虑的应对

最后一步是将认识和思考转化为深思熟虑的行动。即使考虑到风险,“AI的影响”也可能会压倒正确的判断。让员工有权设定界限,重新掌控决策过程。

鼓励他们表达不安或推迟行动,直到最终核实,比如说“我需要书面确认才能继续”,这样可以减缓操控的势头。

这种反应之所以能够实现,是因为一种开放对话的文化,即鼓励员工无需畏惧对指示提出质疑或表达担忧。

在一起最新案例中,一位法拉利高管接到了CEO贝内代托·维尼亚(Benedetto Vigna)的电话。一开始这看起来很可信。但随着谈话内容逐渐涉及机密,这位高管开始怀疑。

他不愿冒险,提出了一个只有真正的CEO才能回答的问题。结果骗局暴露,对方突然挂断了电话。通过过度依赖、拟人化和模糊虚拟与现实之间的界限,我们可以考到“情感纠葛”可能性的增加。

只有真正的人类才会受到情绪影响。但我们也可以调节情绪,做出更好的决策。最终,一个自动化的世界可以从这些策略体现出的人类感知力、人情味和敏感性中受益。

本文作者:

Öykü Işık,瑞士洛桑国际管理发展学院数字战略与网络安全教授

Ankita Goswami,瑞士洛桑国际管理发展学院外部研究员

本文原载于世界经济论坛Agenda博客,转载请注明来源并附上本文链接。

翻译:孙芊

编辑:王灿

不要错过关于此主题的更新

创建一个免费账户,在您的个性化内容合集中查看我们的最新出版物和分析。

许可和重新发布

世界经济论坛的文章可依照知识共享 署名-非商业性-非衍生品 4.0 国际公共许可协议 , 并根据我们的使用条款重新发布。

世界经济论坛是一个独立且中立的平台,以上内容仅代表作者个人观点。

实时追踪:

生成式人工智能

分享:

每周 议程

每周为您呈现推动全球议程的紧要问题(英文)