眼见为实?人工智能让“奥巴马”无所不说

全世界的“整蛊爱好者”们注意了,现在电脑程序能够创建出任何人的“视频副本”,在视频中模仿本人说话。

华盛顿大学的研究者们证实了这一点,他们将前总统奥巴马留下的影像资料进行“声”、“画”融合,创造出了一个“唇语同步”的可编程影像副本。

该程序使用人工智能,以现有的视频资料为基础,来匹配人类说话的语音和嘴形。在分析了几百万帧视频影像后,人工智能成功揭示了嘴形和声音之间的关系,而这一程序也就能够创造出可以乱真的“视频副本”了。

将这一技术用到电影工业中 根据研究人员的说法,这一技术最大的应用前景就在于电影工业,特别是电影特效。目前电影特效中的“声”、“画”融合,都需要让不同的人说同一句话,以此作为特效制作的基础资料。但是这一方法非常低效,而且会产生一种被称为“恐怖谷”的效应——合成效果看起来还算真实,但是不够真实,这就让画面缺乏说服力,甚至让人觉得恐怖。

这一技术还能用于改善低质量视频通话的效果,帮助有听力障碍的人。举例来说,人工智能能够基于电话语音创造唇语影像,帮助残疾人克服听力障碍。

研究团队预测,假如把这整个过程倒转过来,将视频而不仅仅是音频输入到程序中,算法就能够判断出这个视频到底是真是假。

这一做法的目的是改进算法,让它能够学会总结不同的话语情境,并用较少的数据识别一个人的语音和唇语模式。例如1小时时长的视频就足以提供程序所必须的基础资料,而不是目前所需的14小时。

这一程序目前的局限性还是很强,只能基于同一个人所说过的单词来创造属于他的“视频副本”,也就是说,你没法让其他人说出专属于你的台词。

作者:

Charlotte Edmond,Formative Content

以上内容仅代表作者个人观点。

本文由世界经济论坛原创,转载请注明来源并附上原文链接。

翻译:达沃斯博客翻译小组 陈达铿。

责编:刘博睿

世界经济论坛·达沃斯博客是一个独立且中立的平台,旨在集合各方观点讨论全球、区域及行业性重要话题。

不要错过关于此主题的更新

创建一个免费账户,在您的个性化内容合集中查看我们的最新出版物和分析。

许可和重新发布

世界经济论坛的文章可依照知识共享 署名-非商业性-非衍生品 4.0 国际公共许可协议 , 并根据我们的使用条款重新发布。

世界经济论坛是一个独立且中立的平台,以上内容仅代表作者个人观点。

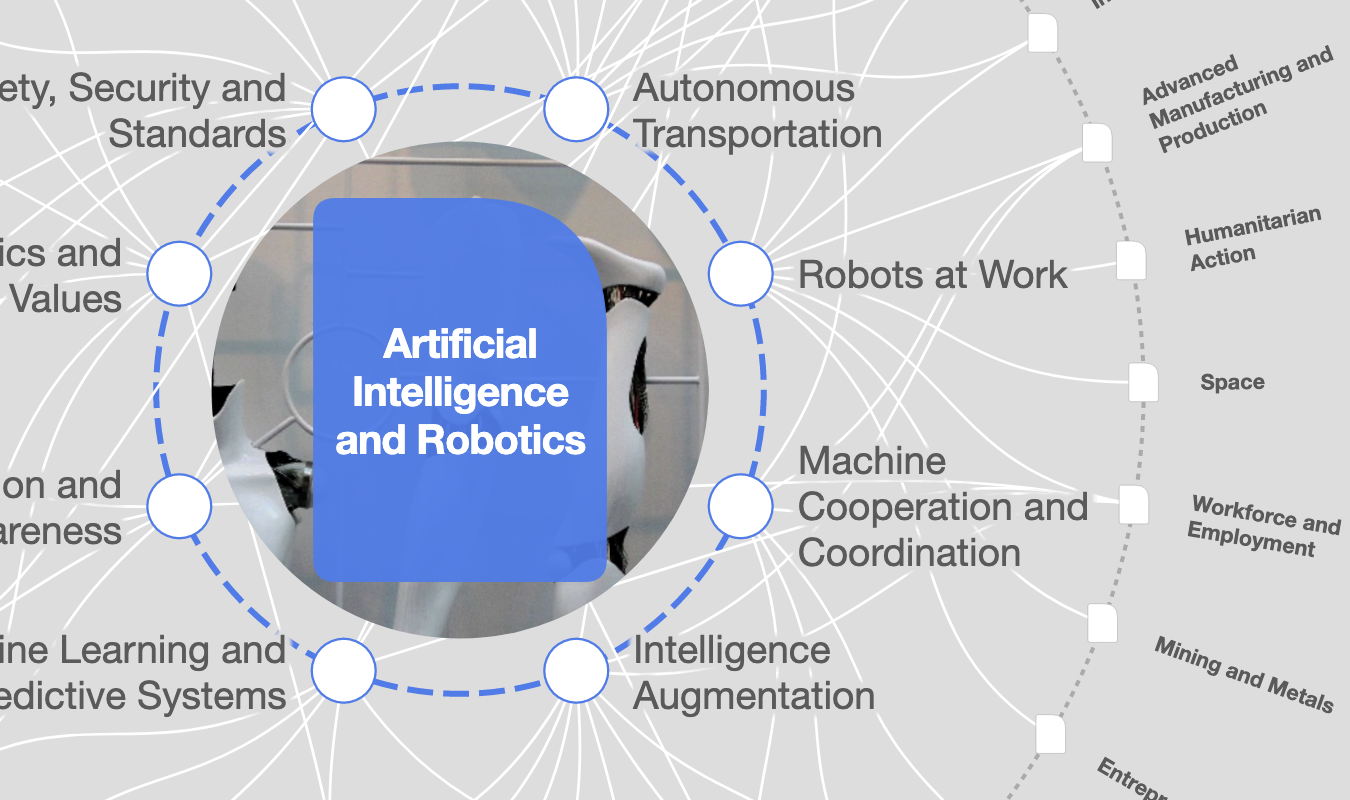

实时追踪:

人工智能与机器人

分享:

每周 议程

每周为您呈现推动全球议程的紧要问题(英文)