如果你的孩子的朋友是个会说话的人工智能玩具会怎么样?

分享:

实时追踪:

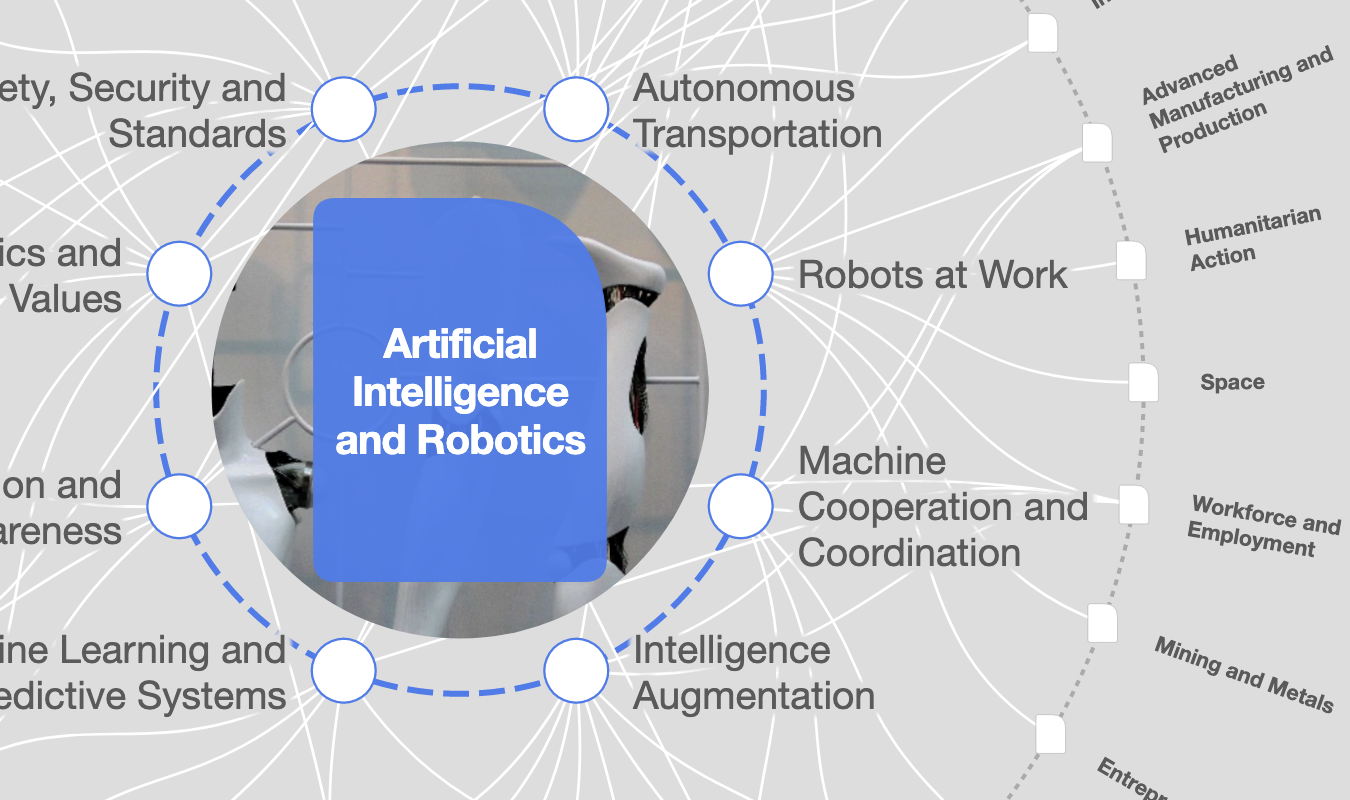

人工智能与机器人

“我的朋友凯拉”是一个联网的玩偶,其采用了声音识别技术与孩子实时对话。凯拉进行的对话会被记录并且通过网络上传到语音分析公司。

这促使了人们对于黑客入侵孩子们的玩具从而实现窥探甚至直接对话的担忧。这也引起了人们对孩子们使用语音数据的思考。2017年,德国监管机构便督促父母毁去这些玩具,并将这类玩具定义为“非法间谍装置”。

凯拉只是人工智能玩具成为孩子们的“玩伴”的浪潮中的一个例子而已。制造者们宣称他们的作品是具有教育意义的、能够与孩子玩耍并且帮助孩子培养社交技能的。但是消费人群却对之亮起警灯,认为智能玩具与我们平时使用的联网设备一样,存在着安全性和隐私方面的风险。

在下面的问答中,世界经济论坛的人工智能和机器学习项目负责人Kay Firth-Butterfield对应该如何在人工智能玩偶变得越发受欢迎的情况下发展进行了阐述。

人工智能玩具收集的数据会如何处理?

这些玩具将连接到互联网(通过无线网络或是蓝牙技术连接到手机或是其他具有互联网接入技术的设备)并且将数据传输给供应商。这使得该公司的人工智能系统能够帮助其学习如何与孩子更好地沟通。

公司将记录并收集孩子们与玩具的对话,甚至是与之“沟通”其他孩子甚至是成人的反应。公司很可能保存这些数据并且利用它们来开发更好的产品。

玩具的定位影响数据的储存方式。比如说,在美国,生产益智玩具的公司的数据可以比别的公司储存更久。因此,当生产者将他们的玩具形容为益智的,那么他们拥有更久地持有数据的权限。

随着越来越多的设备(越来越多被形容为益智玩具)走向市场,这也敲响了隐私、偏见、监控、民主、透明度和问责制的警钟。

Image: Myfriendcayla.com

哪些内容我们应该着重关注?

德国禁止凯拉和类似的玩具进入市场是因为考虑到这些玩具可能成为监听孩子的工具,并且存在黑客入侵设备与孩子直接沟通的可能性。

但是我们同样应该讨论公司将数据变现的问题。这些来自人工智能玩具的数据包含了孩子对机器说的所有的内容,包括了他们最重要的小秘密。

这些数据一旦被收集,孩子们还有可能再把它们要回来吗?如果这些收集自幼儿时期的数据不属于这些孩子,孩子们是否会变得更加脆弱,因为他们的选择和行为模式会被那些购买了这些数据的人知晓,比如一些公司和政治机构。

根据美国隐私法中有关玩具使用的内容来看,一旦数据被收集和保存,则违反了“儿童权利公约”第16条——隐私权。(当然,这里存在争议,因为父母们常常会把孩子的照片发在Facebook等平台上。)

人工智能玩具能带来什么好处?

大多数经济学家认为,促进发展教育是缩小发展中国家和发达国家之间的差距的最佳方式。

人工智能驱动的益智玩具和“老师”也许能给发展中国家带来极大的好处。

但是,如果正如前谷歌中国首席执行官李开复所说,那么从这些设备收集的数据将会被西方和中国的大型人工智能公司所使用,而不是为这些孩子、他们的父母或是他们居住的国家服务。

人工智能玩具会给孩子带来什么样的影响?

除了黑客攻击的风险,我们还需要考虑这些玩具会跟孩子们说些什么。谁是这些对话的仲裁者?谁对这些算法进行编程(他们无意间的偏好是否会蔓延)?孩子们所接触的这些价值观是否与其父母所持的一致?父母是否有权选择编入的价值观?

如果这些玩偶是具有教育意义的,那么这些算法是否会被那些至少拥有教育资格的人检查?

这些玩具的影响力巨大,因为孩子们与它们相处的时间很长。比如说,如果一个玩偶说它觉得很冷,那么孩子可能会向父母要求给它买一件外套,这是否是一种广告?

如果孩子们的玩偶可以对话,而不仅仅是一个“看不见的伙伴”,这是否会影响到孩子们的创造力?孩子们不会再发明一个关于“看不见的伙伴”的小故事。这是否会对孩子们对我们作为人类这一认知产生巨大的影响?

如果这些数据被收集,即使其不被保存,这些公司是否有义务对那些分享了自杀想法或是其他自残行为的孩子警示?如果孩子对玩具说明自己受到了虐待,那么公司是否应该向有关部门报告?然后公司应该如何处理这一类信息呢?

我们可以为保护孩子做些什么?

家长们在购买这类玩具之前应该对这些问题有基本的答案。至少,他们应该检查并赞同他们孩子从人工智能玩具上学到的价值观。

目前,消费者有权知道他们的数据将会用在什么地方,但是有一些讨论认为,公司应当对确保消费者理解数据将会如何使用负责。

在世界经济论坛,我们将会开展一个项目,重新设想监管机构的作用,以便他们能够检验符合目的的算法,而不是监管机构在出现问题之后该如何实施惩罚。

这将会是一种正确的监管模型,因为这正是现在所需要的、也是敏捷治理机制的一部分。然而,对智能玩具监管的问题在于,人工智能在与孩子的互动中学习并且不断调整变化。

这并不意味着我们认为人工智能驱动的玩具是不好的。它们可能在未来的某一天帮助我们实现“因材施教”(使用人工智能对每个孩子所需要的内容进行精准教育)。人工智能玩具可能会促使孩子们为未来与自动化机器人一起工作做好准备。

我们所讨论的是,孩子们非常脆弱,我们现在应该要考虑人工智能应该怎么样用在孩子身上,不能用孩子来测试这些人工智能。

作者:Kay Firth-Butterfield,世界经济论坛人工智能与机器学习项目负责人

以上内容仅代表作者个人观点。

翻译:胡静璇

责编:张智

世界经济论坛是一个独立且中立的平台,旨在集合各方观点讨论全球、区域及行业性重要话题。

更多关于 人工智能与机器人查看全部

Henrik Ekelund

2024年4月17日

Matt Price and Anna Schilling

2024年4月15日

Victoria Masterson

2024年3月31日

Oguz A. Acar

2024年3月29日

Cathy Li

2024年3月25日